У опытных SEO-специалистов обычно есть список технических вопросов для решения проблем с ранжированием и индексацией. Аналогичным образом агентства и консультанты часто проводят углубленные технические проверки, чтобы улучшить видимость результатов поиска для своих клиентов.

Moz составили контрольный список для начинающих SEO-специалистов и владельцев малого бизнеса, которые хотят научиться самостоятельно проводить SEO-аудит небольшого сайта.

Изначально Moz задались целью создать контрольный список технического SEO-аудита, который охватывал бы области, влияющие на рейтинг и трафик. Для них было важно, чтобы чек-лист помогал провести аудит оперативно. В процессе создания аудита они поняли, что SEO-специалисты хотят проверять разные проблемы сайта, влияющие на трафик, не только технические. В итоге список охватывает области SEO, которые способны повлиять на трафик и рейтинг сайта.

Итак, чек-лист для аудита включает в себя:

Содержание

1. Основы

Убедитесь, что у вас установлена аналитика, настроен доступ к поисковой консоли и запустите сканирование сайта.

Установленная аналитика

Пакет аналитики может предоставить объемную информацию о посетителях и технических данных о сайте. Большинство веб-мастеров устанавливают Google Analytics, но для тех, кто беспокоится о конфиденциальности или производительности, существует множество альтернатив.

Настройка свойств поисковых систем

С помощью настройки свойств сайта в Google Search Console или Bing Webmaster Tools (а иногда и в Yandex) можно узнать, как эти поисковые системы просматривают ваш сайт. Многие действия из этого чек-листа значительно упрощаются при наличии доступа к таким инструментам. Кроме того, системы часто дают прямой доступ к конкретным настройкам, которые помогают сайту в ранжировании и видимости, например, отправка карты сайта или международный таргетинг.

2. Сканирование и индексирование

Раздел аудита «Сканирование и индексирование » охватывает основы технического SEO и позволяет убедиться, что поисковые системы могут без проблем находить, сканировать и индексировать ваш контент.

На этом этапе аудита нужно ответить на два вопроса: просматривают ли поисковые системы ваш сайт и индексируются ли важные материалы?

URL проиндексирован

Возможно, это основной пункт всего контрольного списка: отображается ли URL-адрес в Google (или в другой поисковой системе)? Чтобы ответить на этот вопрос, SEO-специалисты обычно проводят одну из двух быстрых проверок.

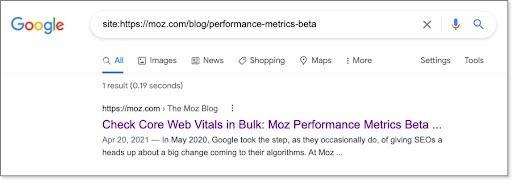

1. Выполните поиск по сайту:

Поиск по «site:», пожалуй, самый быстрый способ проверить, проиндексирован ли URL. Просто введите «site»:, а затем URL. Например:

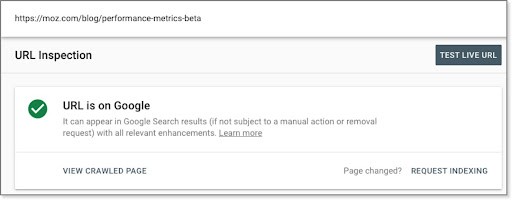

2. Search Console «Inspect URL »

Проблема с использованием поиска «site:» в том, что возвращается все, что начинается с введенного шаблона URL, поэтому он может вернуть несколько URL, соответствующих строке. По этой причине часто лучше искать точный URL с помощью инструмента URL Inspection в Google Search Console.

Инструмент: URL Inspection Tool

Индексирование важного контента

Поиск может индексировать URL-адрес, но ещё стоит убедиться, что поисковые системы в состоянии проиндексировать ваш контент. Попробуйте проверить кэш Google для URL с помощью кода ниже, заменив «example.com » на ваш URL.

https://google.com/search?q=cache:https://example.com/

Если вы не можете запомнить код, в MozBar есть быстрая ссылка на кэш Google. Неплохо держать MozBar под рукой, так как он поможет и в других вопросах аудита.

Примечание: на этом этапе, если вы убедились, что важный контент действительно индексируется Google, не нужно тратить много времени на изучение проблем индексации, описанных ниже. Тем не менее по мере увеличения количества страниц, эти вопросы становятся все более важными для проверки, и всегда полезно потратить на них несколько минут.

Возвращается код состояния 200

Если вы хотите, чтобы поисковые системы проиндексировали URL, он, как правило, должен возвращать код состояния ответа 200 HTTP. Постарайтесь избежать ошибок 4xx и 5xx. Код перенаправления 3xx менее критичен, но он обычно означает, что URL, который вы проверяете, не будет ранжироваться.

Инструменты: MozBar, Link Redirect Trace, httpsstatus.io

Индексируемость по метатегу robots и тегу X-robots-tag

При проблемах с индексацией необходимо быстро проверить, не помечена ли страница директивой robots « notindex ». Отсутствие директивы robots — это нормально, так как по умолчанию стоит «index ».

Чаще всего директивы robots размещаются в HTML в виде метатега robots. Гораздо реже они находятся в заголовке HTTP в качестве метки X-robots-tag. Вы можете изучить оба места, но отчет Google по проверке URL быстро покажет, разрешена ли индексация.

Примечание: если URL не индексируется, используйте «Test Live URL » в Search Console для проверки статуса индексируемости.

Инструменты: Google Search Console, MozBar

URL не заблокирован файлом robots.txt

Заблокированный файлом robots.txt, Google не может просматривать содержимое страницы. И блокировки через robots.txt часто бывает достаточно, чтобы URL не попал в индекс Google.

Если URL прост, вы можете обойтись быстрой визуальной проверкой файла robots.txt. В большинстве случаев потребуется более тщательная проверка URL с помощью одного из перечисленных ниже инструментов.

Инструменты: Google Robots.txt Tester, Robots.txt Validator and Testing Tool

URL, указанный в файле XML sitemap

Технически включение URL в XML sitemap-файл не является обязательным для ранжирования в Google, но это может значительно облегчить поиск ваших URL поисковыми системами, а в некоторых случаях поможет в поиске и даже ранжировании (URL не будет ранжироваться, если он никогда не был просмотрен).

Лучший вариант — включение всех индексируемых URL в XML sitemap или в несколько файлов sitemap.

Расположение файла Sitemap определено в файле robots.txt

Итак, вы убедились, что URL указан в XML sitemap. Далее необходимо удостовериться, что все поисковые системы могут легко найти ваши файлы карты сайта.

Самый простой и понятный способ сделать это — указать местоположение карты сайта в файле robots.txt. Размещение карты здесь работает для всех основных поисковых систем и не требует дополнительных действий. Недостаток такого метода в том, что он потенциально раскрывает карту сайта для сторонних поисковых систем, поэтому в некоторых случаях можно не использовать его, а применить прямую отправку в поисковые системы (см. ниже).

Посмотрите файл robots.txt от Moz, чтобы увидеть пример этого метода в действии.

Отправка файла Sitemap в поисковые системы

Даже если карта сайта указана в файле robots.txt, все равно следует убедиться в том, что вы отправляете XML-карты поисковым системам. Это гарантирует, что:

- Поисковые системы действительно знают о вашей XML карте сайта.

- Поисковые системы сообщат, признали ли они карту сайта действительной.

- Наконец, вы можете получить от поисковых систем отчет о покрытии со статистикой о том, как они посмотрели и проиндексировали URL-адреса, указанные в карте сайта.

И Bing, и Google поддерживают прямую отправку карты сайта. Google особенно радует, поскольку после отправки карты сайта вы можете проверить отчет Google о покрытии индекса для каждой карты.

Инструменты: Google Sitemaps Report, Bing Webmaster Sitemaps.

URL можно обнаружить по внутренним ссылкам/навигации

Карты сайта — это один из способов, с помощью которого поисковые системы обнаруживают страницы сайта, но основным методом по-прежнему остается просмотр веб-страниц и переход по ссылкам.

Как правило, высокоприоритетные страницы должны обнаруживаться в пределах 4-5 кликов от главной — это часть архитектуры сайта.

Поиск бесхозных страниц (на которые не ссылаются никакие внутренние URL-адреса сайта.) не так прост. SEO-краулеры, такие как Screaming Frog и Sitebulb, хорошо справляются с поиском этих страниц, но для их обнаружения требуется подключение к другим источникам данных — например, к картам сайта. URL-адрес, который не хочет быть найденным, иногда трудно обнаружить, если на него нет ссылки.

Лучший способ избежать бесхозных страниц — обеспечить ссылки на важные страницы, либо через навигацию, либо через другие внутренние ссылки. Search Console и многие инструменты SEO-связи могут предоставлять ограниченные отчеты о внутренней перелинковке, но часто решение проблемы требует проверки вручную.

Контент доступен по единому канонизированному URL-адресу

Есть несколько основных рекомендаций, которые следует иметь в виду, когда речь идет о каноникализации и дублированном контенте:

1. Все URL-адреса должны иметь канонический тег.

2. Различные URL-адреса с одинаковым содержимым должны ссылаться на один и тот же канонический URL-адрес. Кроме того, параметры URL, не изменяющие содержание страницы, не должны изменять канонический тег. Например:

https://example.com?parameter=same-content

Скорее всего, канонический URL будет выглядеть следующим образом:

<link href= »https://example.com/ » rel= »canonical »>.

3. Различные шаблоны URL должны вести на один и тот же контент.

В идеале три из четырех должны перенаправлять на «каноническую » версию в зависимости от того, какой шаблон URL является правильным.

Вы можете выполнить простую проверку каноничности с помощью MozBar. Перейдите на URL-адрес и проверьте, содержит ли страница каноническую ссылку на себя. Затем попробуйте добавить произвольные параметры в URL (те, которые не меняют содержимое страницы) и убедитесь, что канонический тег не изменился.

Примечание: наиболее распространенное место для канонических тегов — HTML, вы также можете поместить их в HTTP-заголовок.

Инструменты: MozBar

Канонический тег, выбранный Google, совпадает с выбором пользователя

То, что вы определили канонические ссылки, ещё не означает, что Google будет их засчитывать. Поисковик использует множество сигналов для канонизации, и сам тег canonical является лишь одним из них. Другие сигналы каноничности, на которые обращает внимание Google, включают перенаправления, шаблоны URL, ссылки и многое другое.

Чтобы выяснить, уважает ли Google ваш пользовательский канонический тег, воспользуйтесь Search Console. Используйте отчет «Покрытие» инструмента проверки URL в Search Console, чтобы выявить случаи, когда Google выбирает каноническую ссылку, отличную от выбранной вами.

Вы также можете найти массовый отчет об ошибках каноникализации в отчете об охвате «Исключенные » с пометкой «Дубликат, Google выбрал каноникал, отличный от пользовательского ».

Инструменты: Google Search Console

Отсутствие ошибок смешанного сигнала каноникализации/индексации

Если страница A канонически связана со страницей B, а страница B индексируема, не стоит ставить тег «noindex» на страницу A, так как это пошлет смешанные сигналы.

То есть, если URL является индексируемым, не канонизируйте на него «неиндексируемые» страницы.

Инструменты: MozBar

Дружественная структура URL

Общее эмпирическое правило — максимально упрощать URL-адреса. Обычно это означает:

- использование более коротких, читаемых человеком URL-адресов, когда это возможно;

- избежание ненужных параметров, таких как идентификаторы сессий или параметры сортировки;

- разбитые относительные ссылки, которые вызывают «бесконечные пробелы » (бесконечные URL).

Помните, что простые, богатые ключевыми словами URL также помогают увеличить количество кликов.

Чтобы узнать больше, изучите документацию от Google по структуре URL.

Контент может отображаться с помощью базового JavaScript

Если вы уже убедились, что Google действительно индексирует важный контент, то, скорее всего, у вас нет проблем с рендерингом JavaScript. Но если они в этих областях, а сайт использует JavaScript, то виновником может быть именно он.

Два простых инструмента для проверки того, может ли Google отобразить ваш сайт с базовым JavaScript — это Google Mobile-Friendly Test и функция «Test Live URL» в Google URL Inspection Tool в Search Console. Выберите «View Rendered Page» в Search Console, чтобы просмотреть рендеринг DOM, сообщения консоли JavaScript и ошибки загрузки ресурсов.

Отладка ошибок JavaScript — это большая тема, выходящая за рамки данного контрольного списка, но, по крайней мере, теперь вы знаете, с чего начать.

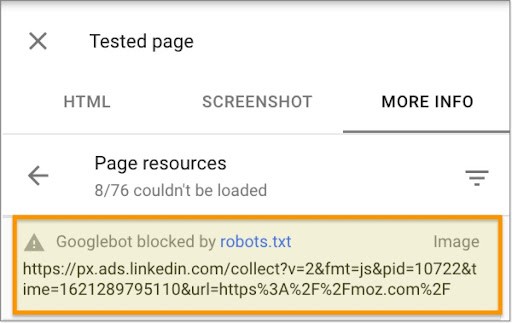

Важные CSS, JS и изображения, не заблокированные robots.txt

Если поисковые системы не могут отобразить вашу страницу, возможно, причина в том, что файл robots.txt блокирует важные ресурсы. Много лет назад SEO-специалисты регулярно блокировали доступ Google к файлам JavaScript, потому что в то время Google не отображал много JavaScript, и они считали это лишним. Сегодня Google необходимо получить доступ ко всем этим файлам, чтобы визуализировать и «увидеть» страницу как человек.

В этом таком случае надо визуально проверить файл robots.txt. Убедитесь, что вы не блокируете важные файлы изображений, CSS или JavaScript, которые не позволяют поисковым системам отобразить страницу. Также можно использовать инструмент Google URL Inspection Tool для обнаружения любых заблокированных ресурсов, как показано здесь:

Примечание: совершенно нормально, если некоторые JavaScript или CSS заблокированы robots.txt, если они не важны для отображения страницы. Заблокированные сторонние скрипты, как в примере выше, не должны беспокоить.

Инструменты: URL Inspection Tool

3. Метаданные и структурированные данные

Метаданные и структурированные данные становятся все более сложными в SEO. Здесь Moz предлагают восемь быстрых проверок для обеспечения максимальной видимости во всех типах результатов поиска.

Рассмотрим метаданные и структурированные данные — «закулисную » информацию, которая не показывается на странице, но помогает поисковым системам понять контент, повлиять на его отображение в результатах поиска, а сайту — занять более высокое место в выдаче.

Страница содержит элемент заголовка

URL должен содержать один тег title с текстом, описывающим вашу страницу. К счастью, отсутствие тега title обнаружить очень легко:

- Браузеры обычно отображают заголовок в заголовке вкладки.

- Большинство инструментов SEO предупреждают об отсутствии и/или пустых тегах заголовка.

- Вы можете проверить заголовок с помощью MozBar.

Если заголовок отсутствует или пуст, обязательно добавьте его.

Инструменты: MozBar

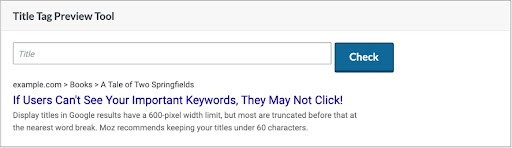

Заголовок содержит важные ключевые слова, видимые в первых 60-ти символах

Вопрос, который часто получает команда Moz: «Какой длины должен быть мой тег title? ».

Ответ, конечно, зависит от ситуации. Google подтверждает, что заголовки могут быть очень длинными. Большинство SEO-специалистов рекомендуют не превышать 55-60 символов, поскольку это предел того, что Google обычно отображает в результатах поиска (на основе длины пикселя).

Более длинные заголовки также могут быть проблематичными, поскольку они часто состоят из шаблонов, частей заголовков, которые часто повторяются в различных разделах сайта, что Google не рекомендует делать.

Независимо от длины вашего заголовка, удачная идея — держать важные ключевые слова в первых 60 символах, где пользователи действительно могут увидеть их в результатах поиска. Сохранение важных ключевых слов в видимой части заголовка может существенно повлиять на количество переходов по ссылкам (CTR).

Инструменты: Инструмент предварительного просмотра тега заголовка

Уникальность тега заголовка

Еще один пункт о тегах заголовков. Они должны быть актуальными.

Последняя проверка тега title — убедиться, что он не дублируется по всему сайту. Несмотря на отсутствие штрафов за дублирование заголовков, Google поощряет уникальные заголовки и не рекомендует шаблонные. Уникальные заголовки помогают поисковым системам различать ваш контент и определять его ценность для пользователей.

Большинство SEO-поисковиков легко выявляют ошибки в дублирующих заголовках.

Если вы хотите проверить только одну страницу, объедините Google site: и intitle: для поиска точного совпадения заголовков на сайте, как показано ниже:

site:moz.com intitle: «Moz – SEO Software for Smarter Marketing ».

Содержит уникальное метаописание

Иногда бывает трудно заниматься метаописаниями, когда данные показывают, что Google игнорирует их 63% времени.

Тем не менее описания остаются важными, поскольку Google будет использовать их, если посчитает, что ваше описание превосходит то, что он может извлечь из страницы. Но… если Google обнаружит дубликаты описаний, он покажет, что вероятность их использования значительно ниже.

Определение фавикона

Несколько лет назад вы никогда бы не нашли ничего о фавиконах в SEO-аудите. Более того, большинство людей до сих пор не обращают на них внимания. Тем не менее фавиконы важны, поскольку Google отображает их рядом со сниппетом в результатах мобильного поиска:

Наличие четкого фавикона, который выделяется, может повлиять на органический CTR.

Как правило, вы можете определить, есть ли на вашем сайте фавикон, просто взглянув на вкладку браузера.

Чтобы быть вдвойне уверенным, убедитесь, что фавикон определен на главной странице сайта с помощью следующего кода:

<link rel= »shortcut icon » href= »/path/to/favicon.ico »>.

OG и социальные метаданные

Для ясности: разметка контента с помощью Open Graph и социальных метаданных (таких как карточки Twitter) нисколько не воздействует на рейтинг в Google. Но социальные метатеги влияют на то, как контент отображается в социальных сетях. Это может сказаться на том, как вашим контентом делятся, ссылаются ли на него и в итоге — на ранжировании.

Большинство современных систем CMS позволяют легко определять OG и другие социальные метаданные и даже задавать значения по умолчанию для этих параметров, поэтому лучше не оставлять их пустыми.

Эти инструменты бывают полезны, когда нужно обновить социальное изображение (или другие данные) и очистить кэш на социальном сайте.

Инструменты: SEO Meta в 1 клик

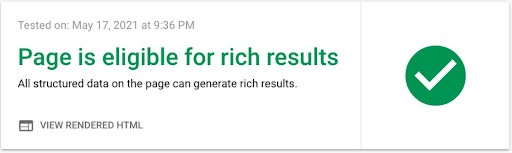

Структурированная разметка

Сначала несколько вопросов и ответов о разметке Rich Snippet Markup:

- Являются ли структурированные данные сами по себе фактором ранжирования? Нет.

- Могут ли структурированные данные помочь в ранжировании? Да, они могут помочь Google понять содержание страницы.

- Могут ли структурированные данные повлиять на CTR? Да.

Сейчас почти каждый URL-адрес должен иметь структурированные данные, которые поддерживают богатые сниппеты Google. Будь то разметка статей, идентификация автора и/или организации, обзоры продуктов или даже разметка рецептов — структурированные данные должны быть четкими и подробными.

Хотя то, насколько часто Google использует структурированные данные, является предметом споров, можно с уверенностью сказать, что они определенно поддерживают типы данных, перечисленные в галерее поиска структурированных данных.

Чтобы проверить свои структурированные данные, воспользуйтесь инструментом ниже.

Инструменты: Google Rich Results Test, Google Structured Data Testing Tool.

Используется настройка max-image-preview:large

Многие SEO-специалисты считают Google Discover отличным источником трафика, но получить заветные места может быть непросто.

Google не устанавливает специальных требований для включения в Google Discover, кроме общих рекомендаций по описательным заголовкам и использованию больших изображений. Поисковик рекомендует использовать изображения шириной не менее 1200 px и с параметром «max-image-preview:large », который показан в этом фрагменте кода:

<meta name= »robots » content= »max-image-preview:large »>.

В качестве альтернативы страница может обслуживаться с помощью AMP. Отметим, что Google, скорее всего, сможет разобраться с вашими изображениями и без этого метатега, тем не менее включить его — хорошая идея.

4. Контент

Многие технические проблемы с контентом могут повлиять на индексацию и ранжирование.

Теперь давайте рассмотрим содержание страницы. Многие из этих пунктов не относятся к техническому SEO, но эти аспекты могут вызвать проблемы с ранжированием, если не принять меры.

Контент не дублируется слишком часто

Google не наказывает за дублирование контента, но повторяющиеся страницы обычно пропадают из результатов поиска, так как Google стремится «показывать страницы с различной информацией ».

Небольшое количество дублирующего контента на странице может быть, но когда большая часть контента слишком похожа на другой в интернете или на вашем сайте, это может вызвать проблемы.

Три способа искать дублированный контент:

- Проведите сканирование сайта с помощью SEO-инструмента.

- Для поиска дублированного контента на одной странице используйте оператор поиска точного соответствия Google, заключив часть текста страницы в кавычки. Например, если мы найдем вступительное предложение к статье Moz «Руководство по SEO для начинающих », мы увидим, как оно было скопировано в интернете.

- Используйте Copyscape — бесплатный детектор плагиата.

Если контент дублируется в интернете, можно подать жалобу DMCA. Еще лучше попросить нарушителей сослаться на вас как на источник или добавить междоменную каноническую ссылку.

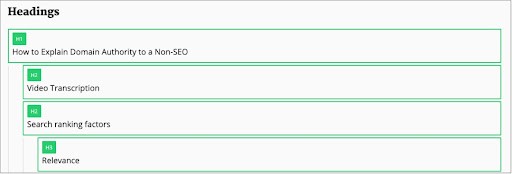

Содержимое, организованное с помощью иерархических HTML-тегов

Должен ли на вашей странице использоваться один тег h1? Сколько тегов h2 нужно?

На самом деле Google всё равно, как вы организуете свою страницу, лишь бы структура была понятной. Как правило, это означает упорядочивание контента с помощью заголовков в иерархическом порядке. Большинство SEO-исследований показывают сильную связь между использованием заголовков и рейтингом Google, поэтому мы рекомендуем использовать заголовки для разумной и логичной организации контента.

Кроме того, один h1 по-прежнему рекомендуется для доступности.

Инструменты: Logical Content Flow

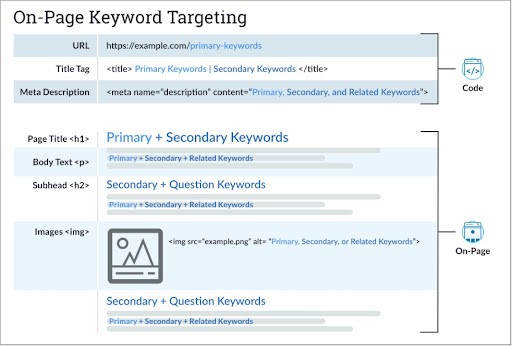

Контент ориентирован на ключевые слова

Долгое время таргетинг ключевых слов был основой для многих SEO-аудитов сайта. Сегодня Google более изощренно подходит к пониманию того, о чем идет речь на страницах. Однако нелишним будет проверить, что на вашей странице в нужных местах присутствуют целевые ключевые слова и связанные с ними фразы:

- URL.

- Тег заголовка.

- Метаописание.

- Заголовок.

- Подзаголовки.

- Основной текст.

- Атрибуты alt изображений.

Конечно, на этом этапе нужно проверить, не набиты ли ключевые слова и постараться этого избежать.

Контент не нарушает рекомендации Google по качеству

Опытные SEO-специалисты могут с первого взгляда определить, является ли контент спамом или заслуживает ли он шанса на ранжирование. В рамках процесса аудита неплохо бы удостовериться, что страница соответствует минимальным стандартам качества и не нарушает рекомендации Google.

Большинство пунктов из списка Google — очевидные вещи, но их стоит перепроверить. Например:

- Отсутствие хитрых перенаправлений.

- Отсутствие клоакинга.

- Ограничение спама, создаваемого пользователями.

- Отсутствие страниц «с дверными проемами ».

Избегайте навязчивых межстраничных объявлений

Всплывающие окна и баннеры, мешающие просмотру контента, часто встречаются на сайтах, особенно на мобильных устройствах.

К сожалению, эти объявления также могут стать причиной снижения рейтинга сайта.

Всплывающие окна по юридическим причинам (например, согласие на использование файлов cookie) и те, которые занимают лишь небольшое пространство, обычно не вызывают беспокойства. Тем не менее если URL-адрес мобильного сайта встречает вас рекламным баннером на весь экран, это, скорее всего, повод для беспокойства.

Избегайте размещения большого количества рекламы над сгибом

Много рекламы над сгибом — это еще одна область, за которую Google может наказать, если сочтет, что реклама сильно отвлекает от контента.

Лучше всего посмотреть на страницу в мобильном браузере, чтобы понять, насколько легко добраться до основного контента. Если эта задача усложняется присутствием большого количества рекламы, вам, вероятно, стоит отметить это в аудите и поэкспериментировать с уменьшением потока рекламы в верхней части страницы.

Контент не загружается в iFrame

Загрузка контента в iFrame может быть сложной с точки зрения технического SEO, и Google обычно не рекомендует этого делать.

Как правило, при использовании iFrame Google «сплющивает» iFrame с вашим контентом и считает его частью самого контента. Обычно это работает, но могут возникнуть трудности, если iFrame не загружается или у Google возникают проблемы с доступом к нему. Иногда использовать iFrame необходимо или удобно, но по возможности их следует избегать.

Контент не загружается во Flash

Flash мертв. Если ваш контент зависит от Flash, ранжирование тоже может быть

неживым. Если страница все еще использует его, большинство браузеров (включая Chrome) просто проигнорируют ее. Чтобы проверить Flash, отчет Search Console о мобильной юзабилити сообщит, использует ли ваш сайт «несовместимые плагины », включая Flash.

Контент с ленивой загрузкой виден во ViewPort

Ленивая загрузка становится все более популярной, особенно после появления встроенной поддержки браузерами. Многие CMS-фреймы, WordPress в том числе, теперь включают ленивую загрузку изображений по умолчанию.

Когда такая загрузка работает правильно, изображения (или другой контент) появляются в окне просмотра (видимая часть браузера), если это необходимо. Когда все идет не так, контент загружается неправильно и не виден поисковым системам.

Самый простой способ проверки содержимого с «ленивой » загрузкой — использовать инструмент URL Google. После ревизии страницы посмотрите на скриншот и HTML, чтобы убедиться, что все изображения загружены правильно. Для более технически подкованных пользователей Google предлагает сценарий Puppeteer, использующий безголовый Chrome.

Поддержка постраничной загрузки для бесконечной прокрутки

Как и ленивая загрузка, бесконечная прокрутка может быть важна для пользователей, но не очень полезна для поисковых систем. При неправильной настройке она скрывает информацию от Google.

Правильный способ реализации бесконечной прокрутки — постраничная загрузка, то есть URL меняется по мере того, как посетитель прокручивает страницу вниз. Пример можно посмотреть здесь. Это позволяет пользователям делиться и добавлять в закладки определенные страницы, а поисковым системам индексировать отдельные разделы материала. Google рекомендует сигнализировать постраничную загрузку с помощью History API. Инструмент сообщает браузеру, когда обновлять отображаемый URL по мере прокрутки страницы.

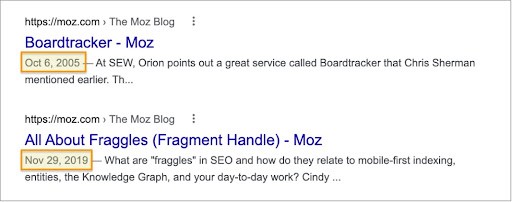

Текущие даты публикации и обновления

Дата публикации вряд ли повлияет на рейтинг, но она может сильно влиять как на CTR, так и на показатели вовлеченности пользователей. Google напрямую отображает даты в результатах поиска, что может сказаться на кликах.

Многие SEO-специалисты предпочитают отображать дату последнего изменения или обновления, чтобы показать читателям, что контент свежий и актуальный. Например, вместо «Published On» вы можете написать «Last Updated» при условии, что информация соответствует действительности. Google знает, когда вы обновили свой контент, поэтому вы не сможете обмануть его.

Несколько общих рекомендаций по отображению точных дат:

- Показывайте видимую для пользователя дату в верхней части страницы.

- Включите свойства «datePublished » и «dateModified » в разметку Schema.

- Сохраняйте последовательность дат. Например, несколько дат на странице могут сбить Google с толку.

Уточните, кто является автором и/или издателем

Авторство — щекотливая тема в SEO-пространстве. Google не подтверждает его влияние на ранжирование, он лишь отслеживает информацию об авторстве и работает над тем, чтобы вычислить автора страницы. Более того, специалисты по оценке качества Google стараются определять репутацию автора и/или издателя. Контент анонимных или малорепутационных авторов/издателей часто оценивается как «низкое» качество, в то время как контент высокорепутационных авторов/издателей — как «высокое» или «наивысшее».

Как правило, Google может выяснить, кто является автором и издателем материала, но лучше ему помочь. Несколько советов:

- Убедитесь, что автор четко указан на странице.

- Включите данные об авторе в разметку Schema.

- Связывайте автора со страницей его профиля, которая, в свою очередь, ссылается на профили в социальных сетях и другие статьи.

- Включите разметку «издатель» в вашу схему статей (или другие типы схем).

- Четко указывайте авторство и контактную информацию на страницах «О нас » и «Контакты ».

Контент не триггерит фильтры безопасного поиска Google

Миллионы пользователей используют фильтры «безопасного поиска» в Chrome, которые не допускают попадания в результаты поиска откровенного контента, например, порнографии. В большинстве случаев эта система работает отлично.

Иногда Google может пометить сайт как имеющий откровенный контент, если он путается в содержании материала.

Если у вас есть сомнения, что сайт может срабатывать в системе SafeSearch Google, лучше всего провести ручную проверку:

- Включите SafeSearch в своем браузере.

- Выполните поиск по сайту: поиск по домашней странице сайта и нескольким определенным каталогам.

- Выключите SafeSearch и повторите поиск.

- Если количество результатов существенно отличается, возможно, сайт фильтруется SafeSearch.

Если на сайте нет материалов для взрослых или конфиденциальных данных и вы считаете, что SafeSearch фильтрует контент ошибочно, можно сообщить о проблеме в Google.

5. Ссылки и навигация

Google использует ссылки различными способами для ранжирования контента. В этом разделе расскажем о восьми пунктах, которые помогут убедиться, что ссылки оптимизированы для сканирования и ранжирования.

Ссылки можно просматривать

Существует много способов создания ссылок. Для того чтобы ссылка была проходимой, поисковым системам обычно требуется тег <a> с атрибутом href. И да, многие разработчики создают ссылки без них.

Быстрый способ проверить, являются ли ваши ссылки просматриваемыми — использовать MozBar для выделения всех ползающих ссылок на странице, как показано ниже.

Страница не ссылается на неработающие страницы (404)

Страницы часто выходят из строя. Интернет буквально усеян 404. Это естественная часть экосистемы. Если вы случайно ссылаетесь на 404-ю страницу, это, как правило, не представляет большой SEO-проблемы.

Тем не менее ссылки, ведущие на 404, могут:

- Создавать неприятные впечатления у пользователей.

- Останавливать поток ссылочного капитала, например, PageRank.

- Говорить посетителям, что страница устарела и не поддерживается.

Исправление неработающих ссылок имеет больший вес, когда вы делаете это масштабно и отдаете приоритет внутренним ссылкам. Если у вас очень объемный сайт, поиск и исправление каждой 404-й ссылки может оказаться низкорентабельным, хотя рентабельность инвестиций возрастает с увеличением важности каждой страницы.

Большинство SEO-краулеров могут определять неработающие ссылки и 404. Если вам просто нужно проверить одну страницу, многие расширения Chrome, Broken Link Checker легко справятся с этой задачей.

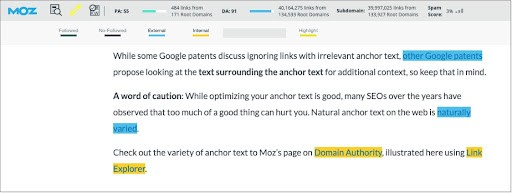

Ссылки используют описательный якорный текст

Ссылки с релевантным якорным текстом обычно очень ценные. Google использует анкорный текст в качестве сигнала ранжирования, и, согласно патентным документам, он может даже игнорировать ссылки с нерелевантным или общим ссылочным текстом.

Наконец, Google обычно не одобряет «чрезмерную оптимизацию », которая может включать в себя размещение ссылок с большим количеством совпадающих анкоров, поэтому полезно все смешивать.

Примеры хороших анкоров:

- список лучших магазинов мороженого в Сиэтле;

- как отменить отправку в Gmail;

- наша страница карьеры.

Примеры универсальных анкоров:

- нажмите здесь;

- читать больше;

- example.com.

Для аудита исходящих ссылок на одной странице вы можете использовать MozBar, чтобы выделить все внутренние и внешние ссылки и убедиться, что якорный текст является описательным:

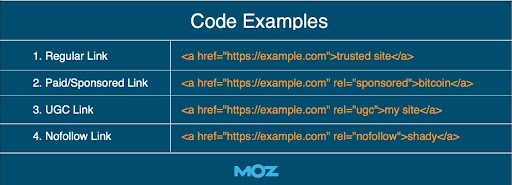

При необходимости ссылки квалифицируются: nofollow, ugc, sponsored

Не так давно Google изменил подход к ссылкам nofollow.

Сегодня Google рассматривает ссылки nofollow как «подсказку» — это означает, что они действительно могут просматриваться и учитываться при ранжировании.

Google также ввел два новых атрибута ссылок:

- «ugc» для обозначения контента, созданного пользователями;

- «sponsored» для обозначения спонсированных ссылок.

Эти атрибуты, наряду с nofollow, помогут защитить вас как издателя. Поскольку Google может наказывать сайты, которые ссылаются на спам или ссылки, дающие финансовый стимул, соответствующая маркировка таких ссылок поможет избежать гнева Google.

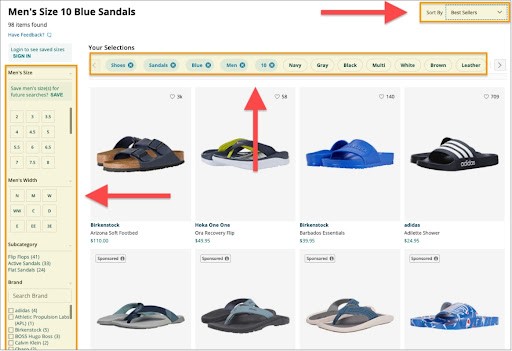

Фасетная навигация не приводит к дублированию контента

Фасетная навигация позволяет посетителям сузить выбор при почти бесконечном ассортименте.

Если вы не будете осторожны, этот почти нескончаемый выбор может создать множество страниц для Google.

Если каждая опция в многогранной навигации связана таким образом, что всякий раз создается новый URL-адрес, вы можете неумышленно сделать миллионы дубликатов страниц для Google.

Несколько советов для многогранной навигации:

- Не создавайте кликабельные элементы для несуществующих опций и не изменяйте содержание страницы.

- Заблокируйте неважные опции в robots.txt.

- Используйте noindex или каноникализацию для URL, которые вы хотите исключить из индекса.

- Используйте инструмент «Параметры» Google Search Console для определения параметров.

Страницы с постраничной навигацией имеют четкие ссылки

Если на сайте используется пагинация (постраничная навигация), важно, чтобы ссылки на страницы были видны поисковым системам.

Недавно Google прекратил поддержку разметки rel=prev/next, хотя другие поисковые системы продолжают ее использовать. Это означает, что основной способ, с помощью которого Google находит постраничное содержимое — ссылки на вашей странице.

В целом, страницы с разбивкой на страницы должны быть доступными для просмотра и четко связаны друг с другом. Сами страницы с пагинациями — самоканонизированными или канонизированными до страницы «Посмотреть все », содержащей все записи.

Страница не содержит чрезмерного количества ссылок

В старые времена Google рекомендовал не более 100 ссылок на странице, но сегодня поисковик может без проблем обрабатывать гораздо больше.

Несмотря на то, что Google может просматривать несколько сотен ссылок (и более) на странице, все же есть причины ограничить количество вариантов для поисковых систем. Множество ссылок затрудняет для Google определение того, какая из них важна.

Если вы обнаружите, что на каждой странице сайта сотни или тысячи ссылок, их можно сократить, чтобы лучше организовать работу со ссылочным капиталом и чтобы сайт правильно индексировался поисковиками.

Наконец, известно, что Google обесценивает ссылки на весь сайт и/или шаблонные ссылки. Если у вас есть навигация в нижнем колонтитуле с одними и теми же 500 ссылками на каждой странице, возможно, стоит поэкспериментировать с другими способами их размещения.

Страница не связана с цепочками редиректов

Полезно проверять исходящие ссылки на наличие перенаправлений и их цепочек. Google заявил, что будет отслеживать до пяти перенаправлений за попытку и может предпринять множество попыток, чтобы в итоге обнаружить конечный URL.

Исправление цепочек перенаправлений снижает вероятность ошибок при повторном индексировании и, таким образом, помогает сохранить ссылочную массу. С другой стороны, небольшое количество перенаправлений 3xx — это совершенно нормально, и их исправление, скорее всего, не принесет значимых результатов.

Что ещё стоит проверять

Изображения

Изображения не только добавляют релевантность страницам, но и повышают вовлеченность, а также помогают в ранжировании.

Видео

Видеоконтент играет всё более важную роль в интернете. Однако многие сайты не уделяют никакого внимания видео SEO. Это одна из областей, в которой Google просто не «разберется» без надежного технического SEO.

Мобильные устройства

Google теперь ориентирован на мобильные устройства. Большинство SEO-аудитов проводится на компьютерах, но несколько быстрых проверок на мобильных устройствах могут повлиять на ранжирование.

Скорость

Скорость загрузки страницы была важна для SEO в течение многих лет, но сейчас ей уделяется ещё больше внимания

Безопасность

Многие SEO-специалисты часто упускают из виду вопросы безопасности, но Google относится к ним очень серьезно. Помимо внедрения HTTPS, есть еще несколько областей, которые необходимо проверить, если на вашем сайте возникли проблемы:

- Сайт использует нужный HTTPS.

- Сайт поддерживает HSTS.

- Нет взломанного контента, вирусов, и других погрешностей.

Обратные ссылки

Обратные ссылки редко включаются в технический SEO-аудит, но отсутствие релевантных обратных ссылок часто причина номер один, по которой качественный, актуальный контент не может ранжироваться.

Вывод

Для ревизии сайта нужен серьезный подход SEO-специалиста. Необходимо проверять и оптимизировать ресурс по таким критериям: основные параметры сайта, мета- и структурированные данные, сканирование и индексирование, контент и ссылки. И это лишь некоторые пункты, на которые стоит обращать внимание. Регулярно отслеживайте корректность функционирования веб-ресурса в поиске, чтобы сайт работал как часы и приносил желаемые результаты бизнесу.

Добавить комментарий

Вы должны зайти как в для комментирования записи