В базе поисковых систем хранится бесконечное множество страниц с разных сайтов. Некоторые из них несут мало пользы. Подобные страницы Яндекс или Гугл считают малоценными и часто не включают в индекс.

Давайте разбираться, что это за страницы, как их искать и что произойдет, если эффективно с ними поработать.

Малоинформативная (малоценная) страница: понятие

Малоценные страницы (на сленге их называют зомби-страницами) имеют мало шансов быть востребованными у пользователей сети. Контент на этих страницах может дублировать уже известные роботу страницы. Также на подобных страницах может быть мало контента или не быть вовсе. Итак, повторим еще раз, зомби-страница – это:

пустая страница без контента (либо содержащая только сквозные блоки),

полупустая страница (где мало контента),

дублирующаяся страница (очень похожая на другую).

Чем плохи эти страницы?

1. Малоценные или малоинформативные страницы снижают краулинговый бюджет сайта

2. Происходит каннибализация ключевых слов

3. Может снижаться авторитет сайта

4. Ухудшаются поведенческие факторы

Какая перед нами стоит задача?

- Найти малоценные или малоинформативные страницы.

- Решить, что с ними делать.

- Закрыть от индексации ненужные страницы.

- Проработать страницы, которые нам нужны.

Как искать зомби-страницы?

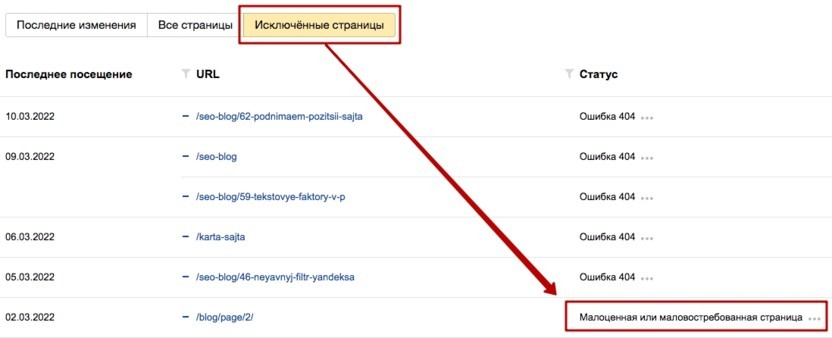

Следует зайти в Яндекс.Вебмастер и посмотреть, какие страницы поисковая система считает малоценными. Заходим в «Индексирование» – «Страницы» в поиске и выбираем «Исключенные страницы».

Как видно на скриншоте, в столбце «Статус» мы видим причину исключения из индекса. Чтобы было удобнее работать со страницами, можем выгрузить их из Яндекс.Вебмастера в таблицу. Если вы работаете с продуктами Google, возможно, данный способ вам не подойдет, поэтому рассмотрим другие варианты.

Существует программа Screaming Frog SEO Spider. Если вы занимаетесь продвижением сайтов, то наверняка про нее знаете. Если нет, устанавливайте ее и сканируйте сайт.

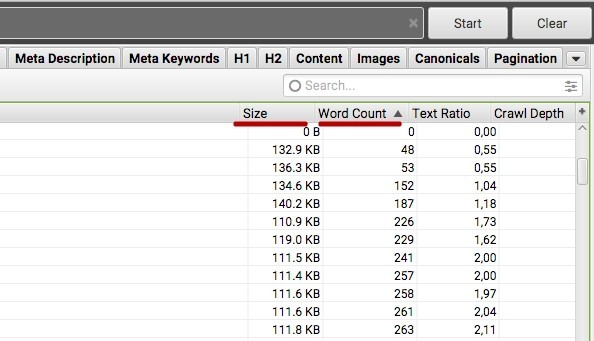

После сканирования вы можете отсортировать страницы по Word Count (количество слов) или Size (размер страницы):

Предположение заключается в том, что чем меньше страница весит, тем меньше там контента и ценности. Аналогично и с количеством слов.

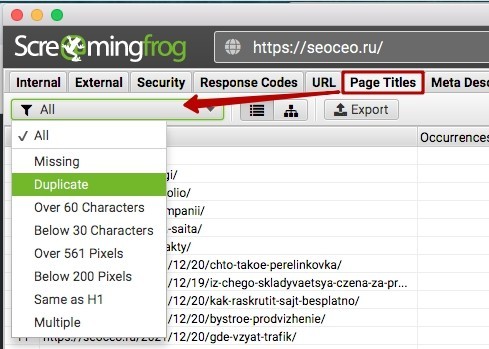

Также, разумеется, стоит проверить дублирующиеся теги, чтобы найти похожие страницы. Заходим на вкладку Title и ищем дублирующиеся мета-теги, как это показано на скриншоте.

Существует еще один способ для поиска зомби-страниц с помощью Яндекс.Метрики. Для этого нужно найти страницы с плохими поведенческими факторами. Например, отсортировать страницы по проценту отказов. Но мне хватает двух вышеперечисленных способов.

Варианты правок

Оптимизируем. Данный метод имеет смысл, когда есть ресурсы и оптимизация страниц может принести весомый профит. Обычно я не работаю с оптимизацией малоценных страниц, а приступаю к следующим вариантам.

Склеиваем. Если у нас имеются одинаковые или похожие страницы, мы склеиваем их с помощью редиректов и перенаправляем с одной страницы на другую.

Закрываем от индексации или удаляем. Существуют стандартные типы страниц: внутренний поиск, сортировка, пагинация, фильтры. Если у нас вылетают из индекса страницы фильтра или другие типы стандартных страниц, стоит закрыть их в файле robots.txt, даже несмотря на то, что они закрыты в canonicals. Для этого в robots.txt нужно прописать строчку:

Disallow: *apply*

Это актуально для страниц типа site.ru/filter/prop_2049-is-ks-set/apply/. Важный момент – прежде чем что-то закрывать, необходимо проверить подобные страницы на наличие трафика. Иначе можно его лишиться.

Работа с малоценными страницами способна принести хорошие результаты с малыми затратами. Чем больше сайт, тем больше даст работа с зомби-страницами. В любом случае советую воспользоваться советами из статьи и оценить результаты.

Добавить комментарий

Вы должны зайти как в для комментирования записи